CIÊNCIA & TECNOLOGIA

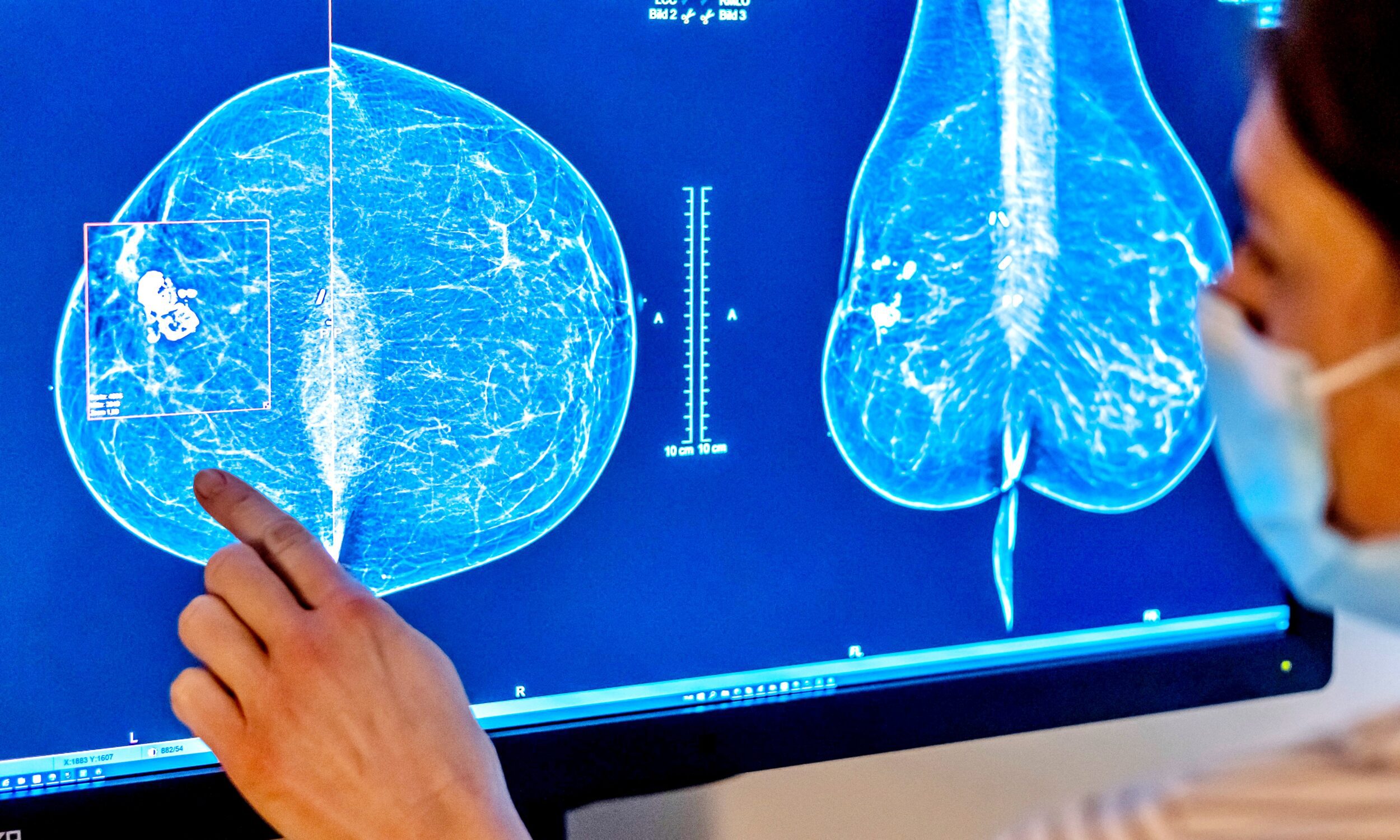

CÉLULAS PODEM SER REPROGRAMADAS PARA COMBATER CANCRO DA MAMA – ESTUDO

Investigadores da Fundação brasileira Oswaldo Cruz (Fiocruz) demonstraram que é possível impedir o crescimento de tumores malignos de mama alterando o perfil dos macrófagos, um dos tipos de células de defesa do organismo, por meio de nanopartículas de óxido de ferro.

Investigadores da Fundação brasileira Oswaldo Cruz (Fiocruz) demonstraram que é possível impedir o crescimento de tumores malignos de mama alterando o perfil dos macrófagos, um dos tipos de células de defesa do organismo, por meio de nanopartículas de óxido de ferro.

O estudo, publicado no International Journal of Pharmaceutics e divulgado pelo maior centro de referência científica do Brasil e da América Latina, revela que o método foi capaz de reduzir em quase 50% a massa tumoral numa espécie de ratos.

De acordo com os investigadores da Fiocruz, cerca de 50% da massa tumoral é composta por macrófagos e a atividade dessas células influencia diretamente o prognóstico do cancro.

Existem dois tipos principais de macrófagos: os macrófagos M2, que têm características mais anti-inflamatórias e estão geralmente associados a uma maior permissividade tumoral, e os macrófagos M1, que são pró-inflamatórios e mais eficazes para limitar a progressão dos tumores.

A abordagem dos investigadores consistiu em reprogramar o perfil dos macrófagos M2 no ambiente tumoral, transformando-os em M1, de modo a inibir o desenvolvimento tumoral.

As nanopartículas de óxido de ferro utilizadas no estudo, que são biocompatíveis, de baixo custo e de rápida síntese, facilitando a produção em escala, foram produzidas nos laboratórios da Fiocruz em Minas Gerais, por meio de uma parceria com o Departamento de Física da Universidade Federal de Pernambuco, que desenvolveu originalmente o composto magnético.

Para chegar aos resultados, os cientistas realizaram três fases de experiência.

Na primeira, foi utilizado um sistema artificial especial para colocar células tumorais da mama em contacto com macrófagos. Ao incubar as duas células, verificou-se que as células tumorais se multiplicavam. Mais tarde, a equipa introduziu as nanopartículas e verificou que as células tumorais morriam.

Com estes resultados, os investigadores realizaram uma segunda experiência com ratos, que foram injetados com células tumorais e nanopartículas e deixados em observação durante 21 dias.

No final do período, a equipa verificou uma redução de quase 50% da massa tumoral nos ratos expostos à nanopartícula, em comparação com os animais que não receberam o tratamento.

A terceira fase, em modelo multicelular tridimensional, simulou o microambiente tumoral e reconfirmou os resultados obtidos nas duas experiências anteriores.

Para o líder do grupo de Imunologia Celular e Molecular e coordenador do projeto, Carlos Eduardo Calzavara, os resultados abrem portas para novos estudos que podem permitir estratégias complementares para o tratamento do cancro da mama.

“O estudo é um ponto de partida. Ainda são necessárias mais pesquisas focadas em farmacodinâmica e farmacocinética para avaliar uma série de questões relevantes, como efeitos fisiológicos, mecanismos de ação, efeitos colaterais, tempo de absorção do fármaco e biodistribuição no organismo, entre outros aspetos”, disse o coordenador em comunicado à imprensa.

CIÊNCIA & TECNOLOGIA

CIENTISTAS CRIAM CÉLULAS PARA TRATAMENTO DA DOENÇA DE MACHADO-JOSEPH

Uma equipa de cientistas liderada pela Universidade de Coimbra conseguiu criar células estaminais humanas, a partir de células da pele, que têm potencial para o tratamento de longa duração da doença de Machado-Joseph, segundo um estudo hoje divulgado.

Uma equipa de cientistas liderada pela Universidade de Coimbra conseguiu criar células estaminais humanas, a partir de células da pele, que têm potencial para o tratamento de longa duração da doença de Machado-Joseph, segundo um estudo hoje divulgado.

A Universidade de Coimbra referiu que esta investigação abre caminho para o desenvolvimento de células que possam vir a ser usadas no tratamento desta doença neurodegenerativa que afeta, nomeadamente, os movimentos e a articulação verbal, e que tem grande incidência em Portugal.

A líder do estudo, Liliana Mendonça, explicou que a descoberta feita pela equipa de investigação demonstra a viabilidade da aplicação de terapias personalizadas a pessoas portadoras desta doença, através da criação de células estaminais dos doentes que se pretendem tratar.

Isto irá traduzir-se numa maior aceitação do transplante, frisou a investigadora do Centro de Neurociências e Biologia Celular da Universidade de Coimbra (CNC-UC) e do Centro de Inovação em Biomedicina e Biotecnologia (CIBB).

Consideradas muito versáteis, as células estaminais permitem dar origem a células especializadas de vários tecidos e órgãos do corpo humano.

A doença de Machado-Joseph ainda não tem tratamento. O cerebelo é uma das regiões do cérebro mais afetadas, levando a extensa morte neuronal, dificuldades de coordenação motora, de deglutição e de articulação do discurso.

“Tem uma grande prevalência nos Açores, especialmente na ilha das Flores, que regista a maior incidência da doença a nível mundial”, contou a investigadora.

A equipa de investigação criou células que demonstraram ter capacidade de originar neurónios em culturas celulares (conjunto de técnicas para testar o comportamento de células num ambiente artificial) e também em organóides cerebrais (tecidos gerados ‘in vitro’, ou seja, fora de organismos vivos).

Segundo Liliana Mendonça, simultaneamente, os investigadores observaram que as células estaminais humanas sobreviveram até seis meses após transplante no cerebelo do modelo animal, tendo-se diferenciado em células da glia (células do sistema nervoso central que desempenham diversas funções) e neurónios, o que significa que revelaram ter potencial para atuar positivamente no controlo de doenças neurodegenerativas.

“Existe uma elevada necessidade de desenvolver estratégias terapêuticas que possam tratar doenças neurodegenerativas, que, de forma robusta, melhorem a qualidade de vida dos doentes, contribuindo, assim, para reduzir os encargos de saúde dos sistemas de saúde e das famílias destes doentes”, alertou.

Este trabalho, que foi desenvolvido pela equipa do Grupo de Investigação de Terapias Génicas e Estaminais para o Cérebro do CNC-UC, encontra-se a ser aprofundado.

Um dos objetivos é estudar de que forma é que estas células conseguem melhorar os problemas de coordenação motora da doença, com recurso a um modelo animal.

A coordenadora da investigação avançou que os cientistas vão também desenvolver estratégias para melhorar a migração das células e, seguidamente, a sua diferenciação em neurónios cerebelares, após o seu transplante para o cérebro, algo que pode aumentar significativamente os efeitos terapêuticos destas células.

CIÊNCIA & TECNOLOGIA

IDENTIFICADAS CÉLULAS-CHAVE PARA PREVENIR A ATEROSCLEROSE NO SÍNDROME DA PROGÉRIA

Uma equipa internacional de investigadores identificou as células-chave para prevenir a aterosclerose em pessoas que sofrem do síndrome de progéria, uma doença muito rara que causa envelhecimento prematuro e acelerado de quem a sofre.

Uma equipa internacional de investigadores identificou as células-chave para prevenir a aterosclerose em pessoas que sofrem do síndrome de progéria, uma doença muito rara que causa envelhecimento prematuro e acelerado de quem a sofre.

A síndrome de Progéria é uma doença genética extremamente rara que afeta 1 em 20 milhões de pessoas, e estima-se que afete cerca de 400 crianças em todo o mundo. A doença é caracterizada por induzir envelhecimento acelerado, aterosclerose grave e morte prematura em idade média de aproximadamente 15 anos.

Os resultados da nova investigação foram publicados esta segunda-feira no The Proceedings of the National Academy of Sciences (PNAS) e participaram no estudo cientistas do Centro Nacional de Investigação Cardiovascular (CNIC) do Instituto de Saúde Carlos III, do Centro de Investigação em Rede de Doenças Cardiovasculares, do Centro de Investigação Biológica Margarita Salas do Conselho Superior de Investigação Científica, da Universidade de Oviedo (todos em Espanha) e da Universidade Queen Mary de Londres (Reino Unido).

As doenças raras representam um grande problema social e de saúde, uma vez que se estima que existam perto de 7.000 e que afetem sete por cento da população mundial, recordou o CNIC, citado pela agência Efe.

Embora os pacientes com este síndrome normalmente não apresentem os fatores de risco cardiovasculares típicos (hipercolesterolemia, obesidade ou tabagismo), a sua principal causa de morte são as complicações da aterosclerose, como enfarte do miocárdio, acidente vascular cerebral ou insuficiência cardíaca.

Atualmente não há cura para a progéria, observou o CNIC, e enfatizou a urgência do desenvolvimento de novas terapias que previnam a aterosclerose e outras alterações vasculares associadas à doença para aumentar a expectativa de vida dos pacientes.

A causa genética da doença é uma mutação num gene (LMNA) que provoca a expressão da progerina, uma versão mutante da proteína nuclear “lamina A” que induz numerosos efeitos nocivos a nível celular e do organismo, explicou o CNIC, em comunicado.

Estudos recentes desta síndrome realizados em modelos animais mostraram que é possível corrigir esta mutação através da edição genética, e que a consequente eliminação da progerina e recuperação da expressão da “lâmina A” melhora as alterações características do doenças e prolonga a expectativa de vida.

Para otimizar a terapia genética para o potencial tratamento de pacientes com progéria, é importante identificar os tipos de células nos quais a deleção da progerina produz mais benefícios.

Para responder a esta questão, o laboratório do investigador Vicente Andrés (CNIC) gerou ratos com esta síndrome e os investigadores apontaram as células musculares lisas vasculares como um possível alvo terapêutico para combater a aterosclerose prematura na progéria.

No novo trabalho publicado pela PNAS e utilizando os mesmos tipos de ratos, os investigadores estudaram se a aterosclerose associada a esta síndrome pode ser evitada suprimindo a progerina e restaurando a “lâmina A” nas células “endoteliais” ou em células musculares lisas vasculares.

Os cientistas descobriram assim que a eliminação da progerina nas células endoteliais não trazia nenhum benefício, mas trazia quando era eliminada nas células musculares lisas vasculares.

-

NACIONAL3 dias atrás

NACIONAL3 dias atrás25 DE ABRIL: A HISTÓRIA DA REVOLUÇÃO

-

DESPORTO DIRETO3 semanas atrás

DESPORTO DIRETO3 semanas atrásDIRETO: VITÓRIA SC X FC PORTO (20:15)

-

DESPORTO DIRETO2 semanas atrás

DESPORTO DIRETO2 semanas atrásDIRETO: FC FAMALICÃO X SPORTING CP (20:15)

-

DESPORTO DIRETO2 semanas atrás

DESPORTO DIRETO2 semanas atrásDIRETO: GIL VICENTE FC X SPORTING CP (20:15)

-

DESPORTO DIRETO3 semanas atrás

DESPORTO DIRETO3 semanas atrásDIRETO: FC PORTO X VITÓRIA SC (20:30)

-

DESPORTO DIRETO2 semanas atrás

DESPORTO DIRETO2 semanas atrásDIRETO: FC PORTO X FC FAMALICÃO (18:00)

-

DESPORTO DIRETO1 semana atrás

DESPORTO DIRETO1 semana atrásDIRETO: FC PORTO X VITÓRIA SC (20:15)

-

DESPORTO5 dias atrás

DESPORTO5 dias atrásCHAVES: NÃO SÃO VALENTES, SÃO VÂNDALOS – ARTIGO DE OPINIÃO